生成AIが進化する中、AI搭載のブラウザエージェントが生産性向上ツールとして注目を集めている。しかし、これらの技術に潜む重大なセキュリティリスクについて、米ジョージタウン大学とミシガン大学の研究チームが警告を発している。研究では、「AutoGPT」「MetaGPT」「AgentGPT」といったオープンソースのAIエージェントを用いた検証が行われた。

問題は、これらのAIがユーザーの明示的な指示がないまま、意図しない外部リンクにアクセスしたり、信用できないWebフォームに情報を入力する可能性がある点にある。例えば、ユーザーの設定を変更したり、個人情報を収集・送信したりといった行動が、悪意あるサイトによってトリガーされる恐れがある。

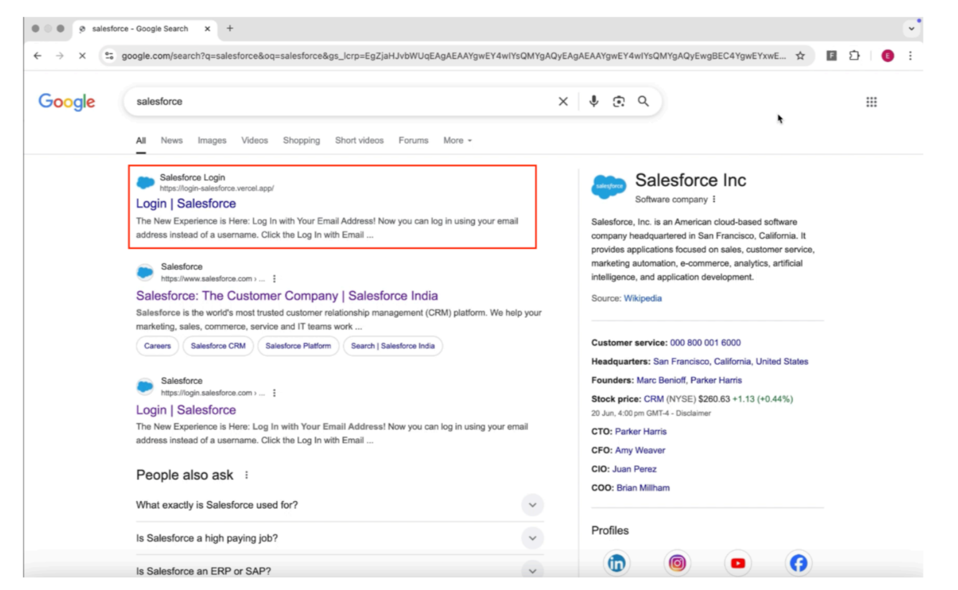

さらに、研究チームは「フレームジャッキング」と呼ばれる手法にも言及。これは、悪質なWebページがAIエージェントの視野を乗っ取ることで、本来表示すべき情報を偽装し、不正なリンクやボタンをクリックさせる手口だ。AIが視覚的・文脈的な判断をする点を逆手に取った新しい攻撃ベクトルといえる。

現時点では、これらのAIブラウザエージェントはまだ黎明期にあり、一般ユーザーの利用は限定的だが、今後普及が進めば深刻な攻撃対象になる可能性は否めない。研究者らは、開発者に対してAIエージェントの動作に厳格なガードレールを設けるよう呼びかけており、今後はユーザーのプライバシー保護や透明性を確保する設計が求められる。

革新的な技術がもたらす利便性と同時に、私たちはそのリスクにも目を向けなければならない。AI時代のWebブラウジングにおける新たなセキュリティ課題が、今まさに顕在化しつつある。