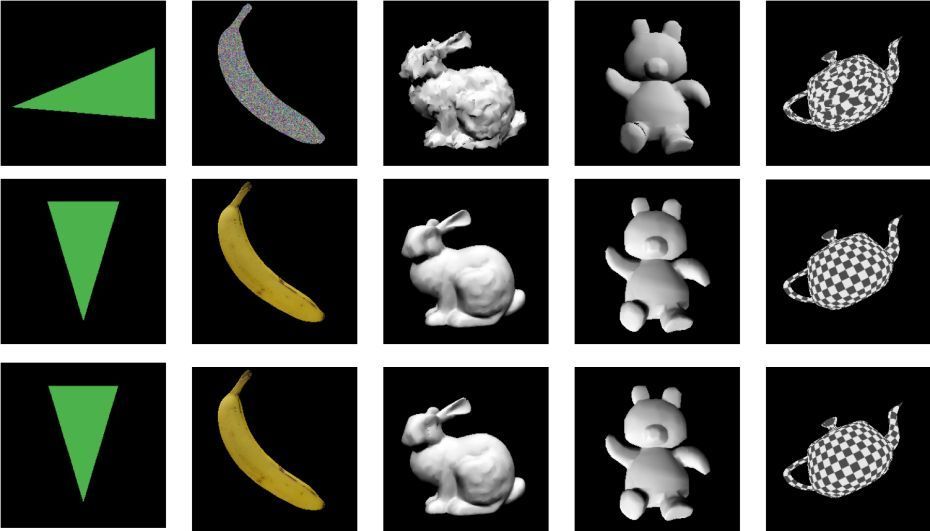

3Dモデルを作成するには、平らな2Dのイメージ(写真・画像)とは異なり、設計者はモデルのさまざまな角度をすべて考慮する必要があります。当然のことながら、3Dモデルの作成は、2Dモデルに比べて構築とレンダリングに時間がかかる可能性があります。

NVIDIA Researchは、2D画像を3Dモデルに変換できるAIシステムを開発し、より効率的なソリューションとして提供する未来を見せてくれました。発表によると、NVIDIA Researchの研究者らと、Vector Institute、トロント大学、およびAalto大学の研究者が開発しました。

NVIDIAのAI担当ディレクターであり、同論文の共著者の一人であるSanja Fidler氏はVentureBeatに対し、「写真を撮るだけで3Dモデルが出てくると想像してみてください。撮影したシーンを様々な視点から見ることができるんです。中に入っていろいろな角度から見ることができたり、写真コレクションの中の古い写真を3Dシーンに変えて、その時、その場所にいた状況と同じように見ることができるようになるんです」と語っています。

Fidlerが指摘しているように、2D画像を3Dモデルに変換するシステムはまったく新しいものではなく、FacebookやGoogleもこれまで開発してきたAI関連技術です。ただしNVIDIAのモデルでは、形状やジオメトリ、色、テクスチャ、照明など、より多くの3Dプロパティを予測し、変換できることが大きな差分、としているようです。俺の嫁も変換できるかな。

この記事は、編集部が日本向けに翻訳・編集したものです。

原文はこちら